Согласно проведенному опросу Стэнфордского университета, более трети ведущих ученых в области программирования выразили опасения относительно использования искусственного интеллекта (ИИ) и возможности его приведения к «ядерной катастрофе». Отчет об индексе искусственного интеллекта за 2023 год, опубликованный Стэнфордским институтом искусственного интеллекта, подчеркивает риски, связанные с быстро развивающимися технологиями ИИ.

Авторы отчета отмечают, что системы ИИ демонстрируют потенциал в ответе на вопросы и генерации текста, изображений и кода, который был невозможен десять лет назад, и они превосходят современные технологии по многим тестам. Однако, по мнению ученых, системы ИИ склонны к галлюцинациям, предвзятости и могут быть обмануты для достижения гнусных целей, что подчеркивает сложные этические проблемы, связанные с их использованием.

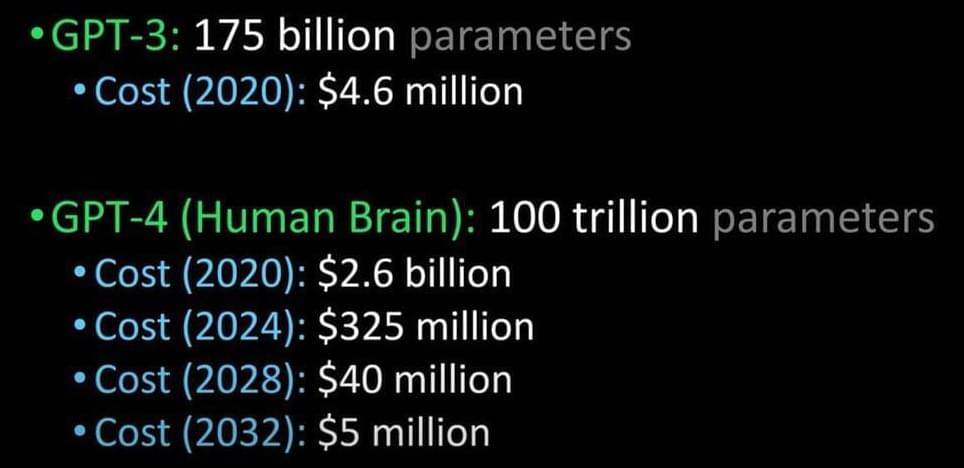

Отчет появился на фоне растущих призывов к регулированию ИИ после серии тревожных новостей, связанных с его использованием. В марте Илон Маск и Стив Возняк были среди тех, кто подписал открытое письмо, призывающее к шестимесячной паузе в обучении систем ИИ, выходящих за рамки уровня чат-бота Open AI GPT-4.

Опрос Стэндфордского университета показал, что 36 процентов исследователей считают, что решения, принятые ИИ, могут привести к ядерной катастрофе. Однако 73 процента полагают, что вскоре они могут привести к «революционным изменениям в обществе». Опрос был проведен среди 327 экспертов в области обработки естественного языка и информатики, ключевой для разработки чат-ботов, таких как GPT-4.